さて、いよいよ映像論も最終局面です。

本日は、バーチャルプロダクションについて話したいと思います。

Virtual Production バーチャルプロダクション

Virtual Production バーチャルプロダクション

Virtual Production バーチャルプロダクションとは

まずはここから

スクリーンプロセス

プロジェクションマッピングで説明したスクリーンプロセスのおさらいからしましょう。スクリーンプロセスというのは、スクリーンを被写体の後ろに配置してその前方や後方から映像を投影し、被写体と同時に撮影する手法のことを言います。特撮VFXの世界ではかなり初期のころから用いられてきました。実はこれが今回話をするバーチャルプロダクションの原点になるのです。

キングコング(3:18-)

virtual Set/Studio バーチャルセット/バーチャルスタジオ

グリーンバック、グリーンスクリーンのスタジオで背景をリアルタイムに描画してリアルタイムに合成するもの

90年代に始まり、テレビ局にはこの手のバーチャルセットがほとんど導入されています。特徴としてはグリーンバックやブルーバックの中でカメラトラッキングを行うことで背景のCGをリアルタイムに合成することです。テレビの生放送などで導入されています。

代表的なのはスペインのBrainStorm(日本の代理店は朋栄)

これらは生放送などで用いられていましたが、グリーンバックの素材も残せるため、後で合成し直すことも可能です。

オンセットビズ On-Set Vis

この流れもバーチャルプロダクションへの中間地点だといえると思います。

さて、一方LEDパネルの普及によって、まったく新しい撮影方法の模索が始まりました。

映画『ゼログラビティGravity』(2013)に見る照明ライティングの実現です。これは複雑な照明の動きに対してLEDパネルで4方を囲ったケージと呼ばれるひとり分のスペースに役者と立たたせ、モーションコントロールカメラで動きを制御するものです。VFXはFramestore(英)

ここでは、バーチャルな背景ではなく、照明や映り込みのためのシミュレーションとしてLEDパネルが使われています。四方をLEDオアネルで囲ったゲージの中で女優サンドラ・ブロックの顔の部分だけを使っています。それ以外の部分はライティングの参考referenceとして使われています。

『ゼログラビティGravity』(2013)本編の抜粋です。

本当に息が詰まるほどの緊張感があります。ぜひ、全編をじっくり見てください。

映画『Oblivion オブリビオン』(2013)

LEDパネルによる屋外空間の再現

3台の高精細カメラで撮影した360°の実写パノラマの映像を三方囲んだLEDパネルに映しています。近未来の惑星の室内を映り込みなどすべて同時に撮影しています。ブルー/グリーンバックで撮影し、後でVFX合成するよりも制作工程を省くことに成功しています。

『Jungle book ジャングルブック』(2016)

ブルーバックで撮影しているものの事前に作成したCGをカメラトラッキングに合わせて描画し、合成していきます。撮影時に監督、カメラマン、役者などが確認しやすくなります。

ブルーバックでのバーチャルカメラの進化

自然物のCGによる再現

この時期にはCGによる自然物、風景、地形、動物などがリアルに表現できるようになっていったことも、バーチャルプロダクションとしての環境がそろったことにつながっています。

これはLion King ライオンキング(2019)

ANIM SQUARE 映画『ライオン・キング』の製作陣が語るVFXの裏側と”バーチャルプロダクション”

LEDの進化とHDRの再現性

LEDパネルは今までは大変高価なものでした。50㎝四方で500万くらいしました。それが今では50万くらいまで価格が安くなりました。加えて色の再現力が格段に向上し、HDRと呼ばれる色深度まで再現できるようになりました。そこで、新しいオンセットでの運用が試みられるようになりました。その初めが『First Man』での巨大LEDを使ったスクリーンプロセスです。手がけたのは英国のVFXスタジオDNEG(ダブルネガティブ)です。

First Man ファーストマン(2019)

ここでLEDの話をしましょう。

砲弾型DIP(1R1G1B)⇒独立したR(赤)G(緑)B(青)で1つの素子を構成。

従来の大型のビジョンに多い。

新しいSMD(3in1)⇒1つの素子でRGBを表現。

DIPよりも混色率が高く映像が美しいため近距離でもみやすい。

視野角が広いので正面からでなくてもみやすい。

LED素子の間隔をピッチと言います。今までのLED素子のピッチは6㎜~20㎜程度でしたが、現在は1㎜~3㎜になってきました。

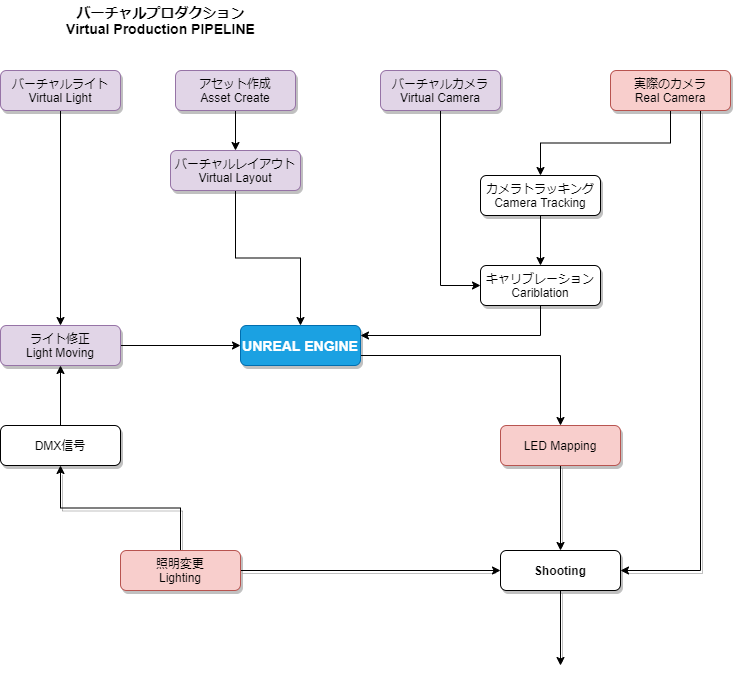

そして、2018年、UNREALエンジンとカメラトラッキング、LEDパネルの組み合わせで今までになかった新しいプロダクションシステムが開発されていきます。

そして、『マンダロリアン The Mandalorian』の中で

ILM+Epic Games、UNREALエンジンという組み合わせがバーチャルプロダクションをひとつ開花させていきます。

『マンダロリアン The Mandalorian』(2019)

カナダにあるVFX Studio PIXEL MONDO のVirtual Production

日本の状況

日本でもバーチャルプロダクションを設置する動きが急激に加速しています。昨年から今年にかけて様々なプロダクション、企業が名乗りを上げています。

SONY PCL

ヒビノ

Hibino VFX Studio

バンダイナムコ 未来研スタジオ

TOHO Studio x NETFLIX

LEDスクリーン中国ROE社「Black Pearl BP2」5m×15m+4m×6mスクリーン、2.84mmピッチ高精細1500nit

BLACKBOXXスタジオ

音楽アーチストのライブ配信スタジオとして機能する4面LEDスタジオ。映画などのバーチャルスタジオではないが、今後はこの手のLEDスタジオも増えていくと思われる。

バーチャルプロダクションのまとめ

大切なことは、LEDパネルを撮影しているということ

つまりはLEDに映し出された映像がどのように撮影されているかを確認していかないと、本来のバーチャル(CG)で作られた正しい色や明るさを再現できないということになります。ここはまだまだ難しいところだし、実際のバーチャルプロダクションできちんと出来ているところは少ないと思います。みなさんは、正しい技術を理解してバーチャルプロダクションなどにも取り組めるようになっていってください。

まとめ

バーチャルプロダクション Virtual Production

撮影(Production)現場にバーチャル(CG)を持ち込む技術

様々な技術を組み合わせていくと

今までにない表現が可能になる合成、ポスプロのパイプライン(工程)が変わる

- スクリーンプロセスの原理←←←これが原点です

- ブルーバック/グリーンバック クロマキー技術との組み合わせ

- バーチャルセット/バーチャルスタジオ(90年代~)

- プレビズ カメラトラッキング+バーチャルカメラ(00年代~)

- オンセットビズの流れ(10年代~)

- LEDパネル 低価格化、高精細、HDR対応

- HDR/シーンリニアワークフロー

- DMX照明との連動

- ゲームエンジン UNREALの発達

まだまだ解決しなければいけない課題もある

- CG/VFXの工程がプリプロダクション化する(撮影までに制作)

- プリプロダクション、ポストプロダクションの工程が大きく変わる

- カメラ、レンズキャリブレーション、トラッキング

- スタジオでの調整のノウハウ 空間座標

- 誰がルック、データを管理するのか?CGVFXチーム?DIT?カラリスト?

トラッキングシステム

STYPE(国内代理店はナック)

https://stype.tv/

https://www.nacinc.jp/creative/brand/stype/

BLACKTRACK(ライトのトラッキングも出来る)

https://blacktrax.cast-soft.com/

PosiStageNet

https://www.posistage.net/

AUGMENTA

https://augmenta-tech.com/

トラッキング情報をFreeDプロトコル(映像信号に重層する?)

詳細不明

我がMIRAI-LABO.(渡部健司研究室)でもバーチャルプロダクションにかんする研究、開発をおこなっています。

今年の隣地実務実習の中でおこなった一つの成果『Virtual Production in IPUT2022』

学内で構築したバーチャルプロダクション

『Virtual Production in IPUT/バーチャルプロダクションin IPUT』

Contents

SixTONES –MV『共鳴』

ソニーPCL「清澄白河BASE」最新バーチャルプロダクションスタジオで撮影。ステージ、CG背景、照明の連動が見事!

日向坂46『僕なんか』(2022)

背景がUNREAL ENGINE。とうとうリアルタイムCGの時代がやってきた。監督 安藤隼人。制作はP.I.C.S.

技術の融合が次のイノベーションを生む。そのための基礎的な技術の習得、知識の収集をしていきましょう。

常に問題や課題点を捉え直し、次の解決に導いていって欲しいと思います。

昨年のInterBEE(国際放送機器展)でのインタビューです。

バーチャルプロダクションに関してしゃべっています。